從現(xiàn)在起開始陸陸續(xù)續(xù)寫一些吧,大概的計劃是將Pattern Recognition and Machine Learning的學(xué)習(xí)體會寫一個專題,然后繼續(xù)deep learning方面的論文學(xué)習(xí),當(dāng)然也有編程方面的東西,希望能夠好好堅持。下面是近期看的層級實時網(wǎng)絡(luò)(HTM)的總結(jié),HTM也是deep model的一種。這部分內(nèi)容基本是本人脫離論文進行的回顧,如果有錯誤,各位看官還望原諒及指正,謝謝!

PART ONE: OUTLINE

皮質(zhì)學(xué)習(xí)算法

Cortical Learning Algorithm

摘要

Abstract

緒論

Introduction

1、皮質(zhì)學(xué)習(xí)算法的歷史沿革

2、皮質(zhì)學(xué)習(xí)算法的主要思想

3、報告的主要框架

George博士論文中的層級實時記憶算法

HTM: version I in George’s PhD thesis

1、整體框架

2、識別

3、學(xué)習(xí)

4、總結(jié)

Numenta白皮書中的層級實時記憶算法

HTM: version II in Numenta’s White Paper

1、整體框架

2、Sparse Distributed Representation

3、Spatial Pooler

4、Temporal Pooler

5、與Version I的內(nèi)在聯(lián)系與主要區(qū)別

6、總結(jié)

層級實時記憶算法的實現(xiàn)

The implementation of HTM

1、Encoder

2、Spatial Pooler

3、Temporal Pooler

4、CLA Classifer

5、總結(jié)

總結(jié)與展望

參考文獻

PART TWO: REPORT

皮質(zhì)學(xué)習(xí)算法

Cortical Learning Algorithm

摘要

Abstract

皮質(zhì)學(xué)習(xí)算法是一種對新大腦皮質(zhì)層結(jié)構(gòu)與功能運作進行人工模擬的算法。本篇報告主要闡述了皮質(zhì)學(xué)習(xí)算法的發(fā)展概況,核心算法(Hierarchical Temporal Memory: HTM)以及算法中的關(guān)鍵技術(shù)。通過對HTM算法各設(shè)計細節(jié)的分析,對HTM算法的演變進行學(xué)習(xí)和思考,加強對算法核心內(nèi)容,如空間模式與時間模式的提取,稀疏離散表征等的理解。同時,對開源代碼及相關(guān)報告材料的學(xué)習(xí),加強對皮質(zhì)學(xué)習(xí)算法細節(jié)的把握。

緒論

Introduction

1、皮質(zhì)學(xué)習(xí)算法的歷史沿革

2、皮質(zhì)學(xué)習(xí)算法的主要思想

3、報告的主要框架

George博士論文中的層級實時記憶算法

HTM: version I in George’s PhD thesis

層級實時記憶算法是模擬新皮層大腦結(jié)構(gòu),試圖模仿起功能的算法。首先,層級實時算法采用了層級結(jié)構(gòu),HTM算法由低層級到高層級依次提取low-level到high-level的不變特征,或者說更高層是低一層不變表示的重新組合。如果能夠在底層級學(xué)習(xí)到事物的一些最基本的模式,再通過高層級進行再組合,那么可以通過學(xué)習(xí)某些物體的模式時而達到將新事物的基本模式也包含的情況,即有較高的泛化能力。同時,通過層級結(jié)構(gòu),底層級學(xué)習(xí)一些low-level的不變特征或者子模式后,直接可以輸入到高層進行學(xué)習(xí),高層級不用再對low-level的特征或者模式進行再學(xué)習(xí),提高學(xué)習(xí)訓(xùn)練的效率,也減小了存儲空間。

HTM算法另一個最突出的特點是引入了時間模式。之前很多deep model的層級結(jié)構(gòu)大多只關(guān)注層級之間的連接(connections),這樣使得他們能夠提取較好的空間模式;但是他們沒有考慮到層級內(nèi)部節(jié)點的連接,這種連接能夠?qū)W習(xí)到序列模式在連續(xù)時間內(nèi)的轉(zhuǎn)移關(guān)系,進行序列記憶,在表征物體的空間模式集有交集的時候,通過時間相近,模式相似的準則可以增加物體識別分類的精度。下面,通過參考David的技術(shù)報告[]與George的博士論文[],將對George博士論文的HTM方面的理論進行詳述。

1、整體框架

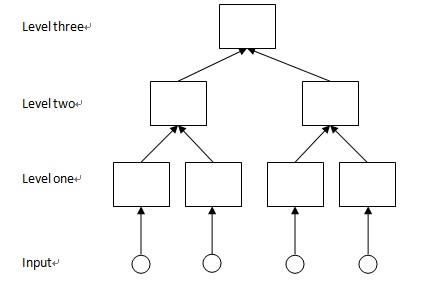

如下圖1為一個三層的HTM示意圖,方塊表示節(jié)點。可以看出,HTM具有樹狀的層級網(wǎng)絡(luò)結(jié)構(gòu)。高一層一個節(jié)點與其相鄰低一層的多個節(jié)點相連接, HTM的第一層節(jié)點直接與輸入相連(可以是overlapping的)。而某一個節(jié)點,不斷向下一層回溯,到輸入,他所處理的輸入范圍就是其感受域,如level one中的每個節(jié)點的感受域是1,level two的是2,level three的是4。

節(jié)點是HTM中記憶與預(yù)測的基本單元。在節(jié)點中,主要存有三種數(shù)據(jù),C(coincidences的集合), G(temporal groups的集合,每個group實際上是coincidences的集合),transition probability matrix(為每個group中各個coincidence之間的轉(zhuǎn)移概率組成的矩陣)。

每一個處于中間層(除開第一層與最后一層)節(jié)點,都有唯一一個父節(jié)點,與多個子節(jié)點。HTM對空間模式的提取,依賴的是父節(jié)點對各子節(jié)點的子模式的pooling,而時間模式與序列記憶的實現(xiàn),依賴于節(jié)點中不同的temporal groups以及其各coincidences組成的markov chains。通過記憶不同order的markov chains,可以由一個coincidences往前或者后推知另外coincidences發(fā)生的可能性,從而實現(xiàn)序列記憶。而每個group也是由這種coincidences之間轉(zhuǎn)移概率最大化分類,以獲得時間相近,模式相似的結(jié)果。

對于一個HTM模型,其識別的整體流程是:當(dāng)某一層各節(jié)點分別接收來自其子節(jié)點的輸入時,開始進行識別,其結(jié)果作為父節(jié)點的部分輸入。而對于一個HTM模型的訓(xùn)練學(xué)習(xí),首先要對最低層進行訓(xùn)練,訓(xùn)練完畢后,再對高一層進行訓(xùn)練,而輸入來自低層按識別流程處理得到的結(jié)果。下面幾節(jié),將從單個節(jié)點的訓(xùn)練與識別進行展開介紹。

圖1 HTM結(jié)構(gòu)示意圖

2、學(xué)習(xí)

在學(xué)習(xí)階段,大致分為3步,對新模式進行記憶,轉(zhuǎn)移概率矩陣的計算,對模式進行分組獲取temporal groups。

I,模式進行記憶。當(dāng)一個節(jié)點接收到一個新的模式時,首先是將輸入模式與節(jié)點中已存在的模式進行比較(如,比較距離),如果該輸入與某個存在的模式足夠近,那么就激活該模式。如果沒有找到足夠近的模式,那說明這個輸入模式是一個新的模式,將他存入模式集中,以待后用。這就是模式的記憶。

II,轉(zhuǎn)移概率矩陣的計算。當(dāng)一個模式被激活,回顧之前激活的模式,將矩陣中對應(yīng)兩者轉(zhuǎn)移關(guān)系的位置自增1。當(dāng)然,HTM也可以存儲多步的轉(zhuǎn)移,回顧數(shù)步以前被激活的模式,存儲其轉(zhuǎn)移關(guān)系。在所有模式輸入完畢,對轉(zhuǎn)移矩陣每行或每列(視存儲情況定)進行歸一化,得到轉(zhuǎn)移概率。

III,temporal groups的計算。根據(jù)轉(zhuǎn)移關(guān)系的統(tǒng)計,可以知道哪些模式轉(zhuǎn)移相對頻繁,而哪些模式之間轉(zhuǎn)移概率相對較大。Temporal groups的計算的原則就是基于此,選取一些轉(zhuǎn)移較頻繁的模式作為種子點,從該種子點向與其轉(zhuǎn)移概率最大的點進行生長,達到一定數(shù)目停止生長,從而實現(xiàn)temporal groups的分類。而每個group以及其coincidences之間組成的markov chain是模型序列記憶的關(guān)鍵。

需要注意的是,在訓(xùn)練完畢一層之后,再訓(xùn)練更高層時,首先利用識別流程,將前些已經(jīng)訓(xùn)練好的層級的結(jié)果輸出到更高層,進行學(xué)習(xí)訓(xùn)練,但是這里,一般將concatenation的各輸入(子節(jié)點的輸出)中最大值位置設(shè)為1,而其他位置置為0(David處理方法是每個coincidences為#(子節(jié)點數(shù)目)維向量,每個元素存的是最大值位置索引,感覺這種省存儲空間)。這實質(zhì)上是一種稀疏化的處理,之后在介紹Numenta里面的HTM與現(xiàn)在介紹的HTM的聯(lián)系和區(qū)別時還會提及。

3、識別

在識別階段,假設(shè)每個節(jié)點的C,G,transition probability matrix已經(jīng)訓(xùn)練好。一個節(jié)點的輸入過程一般分為兩步,首先計算對當(dāng)前輸入,提取所有coincidences對該輸入的certainty;其次是計算對當(dāng)前輸入,提取所有groups對該輸入的certainty。

I,提取coincidences的certainty。對于第一層的節(jié)點,這種certainty通常是通過考量輸入與模式之間的近似程度來實現(xiàn),而對更高層,coincidences里面存的是各個子節(jié)點哪些temporal groups共同出現(xiàn),所以這些子節(jié)點的temporal groups對該輸入的certainty共同組成該coincidence對該輸入的certainty。

II,提取groups的certainty。同理,groups里面是指哪些coincidences會共同出現(xiàn),一個groups的certainty由這些coincidences的certainty共同組成(都是概率相乘)。

III,關(guān)于識別的一些思考

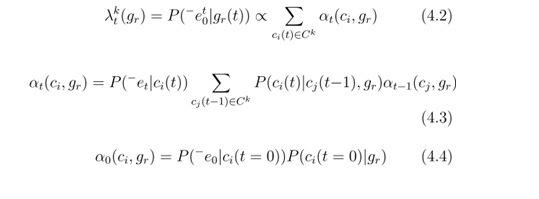

考慮上面公式(來自George論文,公式含義不細說),在序列記憶的情況下,實際上每個group的certainty不僅僅考慮了他包含的coincidences對他的貢獻,同時通過序列轉(zhuǎn)移情況,能夠知道某個coincidence在前面已有序列條件下,現(xiàn)在出現(xiàn)的概率,這種序列記憶能夠更好地反映出一個coincidence對某個輸入的certainty。當(dāng)然,在David的報告中,大多數(shù)情況下以下圖中公式(4.4)為基本,沒有考慮多步的轉(zhuǎn)移。

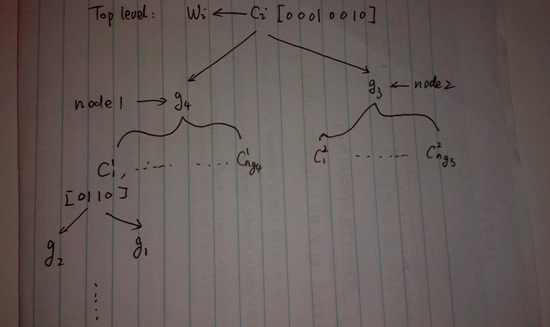

考慮下面示意圖2(參考David論文),一個類別可能主要有部分輸出節(jié)點中coincidences的certainty來確認,而這些coincidences只由部分子節(jié)點的groups共同生成,如此類推下去,可以知道一個類別的模式由部分最基本的模式組合表達,就印證了當(dāng)系統(tǒng)學(xué)習(xí)到一些基本模式后,對于具有這些基本模式的事物具有泛化能力。

圖2 HTM泛化能力的示意解釋,見正文

注意這里將所有的模式對輸入的certainty都計算在內(nèi),這與訓(xùn)練中只激活一個模式是有區(qū)別的,在訓(xùn)練中如果將所有模式激活就無法得到轉(zhuǎn)移概率矩陣了。同樣這與Numenta白皮書里的cell激活方式也稍有不同,下面會再講。

4、總結(jié)

這一部分主要對George文章中的HTM算法進行基本的總結(jié)。通過對于兩篇文章的綜合,可以對于該HTM模型的所有細節(jié)具有比較清楚的認識,包括如何處理圖像(如按zig-zag對圖像序列化,圖像像素或者子塊或者對像素鄰域提取的特征如何輸入到節(jié)點)等都能有具象的認識。但這里只是回顧了一些主要的流程。核心點:通過高層對低層模式的再組合,提升系統(tǒng)的泛化能力;每個group實際上是對序列的記憶,轉(zhuǎn)移概率大小體現(xiàn)了模式之間在時間上相近程度。

Numenta白皮書中的層級實時記憶算法

HTM: version II in Numenta’s White Paper

該HTM版本[10]在George博士論文的版本上進行了一些修改與改進工作,在新版本中撤除了節(jié)點的概念,更多地去模擬新皮質(zhì)的結(jié)構(gòu),引入了區(qū)域,細胞,樹突,突觸等生物學(xué)領(lǐng)域的概念。但是最基本的原則是沒有變化的,就是層級結(jié)構(gòu),記憶-預(yù)測等。當(dāng)然,新版本里面還引入了稀疏離散表征(sparse distributed representation)的概念。

1、整體框架

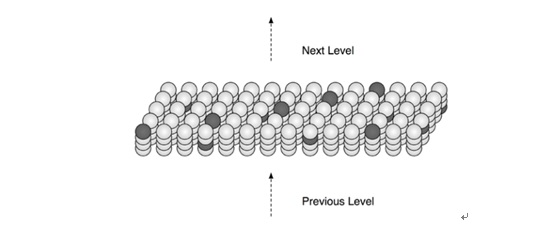

在新版HTM中,層與區(qū)域的概念相似,如圖3中為一個層級(區(qū)域:region)的示意圖,該層級接收其下一層的信息,處理后,輸出送至更高層進行處理。每層有許多列(column)組成,形成二維平面(非必須),而每個列中包含有多種細胞(cell)組成。在每個列與輸入之間,有一個樹突(dendrite segment),它有許多潛在突觸(synapse),可能會與輸入中的部分子集相連接;而每個細胞有許多樹突,每個樹突也有許多潛在突觸,可能與其他細胞進行橫向連接。在圖3中沒有顯示出來。

對于HTM的識別、學(xué)習(xí)都分為兩個流程,首先對輸入進行稀疏離散表征,完成spatial pooling(sp),學(xué)習(xí)階段會對突觸的權(quán)值進行更新;其次,基于spatial pooler的結(jié)果,進行橫向信息傳遞、預(yù)測,完成temporal pooling(tp),學(xué)習(xí)階段也會對突觸的權(quán)值進行更新。Temporal pooling的輸出作為更高層的輸入,重復(fù)剛才的過程。識別和學(xué)習(xí)沒有明顯界限,在識別階段可以將學(xué)習(xí)的部分功能關(guān)閉即可。下面小節(jié)將以一個區(qū)域為例,對HTM的識別與學(xué)習(xí)進行比較詳細地介紹。

注:需要特別指出的是,每個column如果被激活(之后會解釋什么是激活狀態(tài)),那么它是能夠表征模式的部分含義的,對于一個輸入模式,就被一組稀疏的活躍column進行有效表征。但是我們知道,“ABCD”與“EBCF”中的模式B與C是不一樣的,那么在HTM中如何實現(xiàn)不同上下文的表征呢?HTM中,每個column擁有很多細胞,在不同的上下文時,激活的細胞是不一樣的,這樣就達到了能夠表征不同上下文中相同內(nèi)容的目的。

圖3 HTM一個區(qū)域(層級)的結(jié)構(gòu)

2、Sparse Distributed Representation

在介紹sp與tp之前,首先要對稀疏離散表征進行描述。稀疏離散表征是HTM的重要基礎(chǔ),序列記憶等都基于稀疏離散表征。稀疏離散表征是將自然界語言(如圖像,文本,音頻等)轉(zhuǎn)換為二進制序列,而且是稀疏的。稀疏離散表征的每一個活躍(值為1)的bit都能表達模式的部分含義,但是僅僅一個bit又是不夠的,只有整體才能表達一個完整的模式。稀疏離散表征具有很多很好的性質(zhì):

I,在比較時,只要兩個不同的稀疏離散表征具有一些相同的活躍bits,那么這兩個稀疏離散表征表達的模式具有一定的相似性。

II,在存儲時,可以對稀疏離散表征進行subsampling,而能較好地保留其表達含義。這樣節(jié)省了存儲空間。

III,不同的稀疏離散表征做OR運算后,為這些稀疏離散表征的組合,如果一個新的稀疏離散表征的活躍的bits來自于這個組合,那么可以肯定他在這個集合中的membership。一個有趣的現(xiàn)象是,當(dāng)訓(xùn)練了序列”ABC”“ABD”后,如果輸入“AB”,它所進行的預(yù)測就是“C”與“D”的組合。下面我將介紹如何得到稀疏離散表征。

IV,正是因為一個bit可能只表示非常少的模式信息,所以對噪聲不敏感,有些許bits不同的兩個模式可能也是相似的。

3、Spatial Pooler

首先,對于區(qū)域中的每個列(column)都有一個receptive field,來接收輸入中的子集,其樹突上的活躍突觸(權(quán)值大于一定閾值,初始化時權(quán)值在閾值附近進行隨機取值)將與輸入的bits連接,如果連接到活躍bit(=1)的活躍突觸數(shù)目大于一定閾值時,認為該column可以作為活躍column的備選。

然后,為了達到稀疏表征的目的,不希望太多的column能夠激活,所以在一定的抑制半徑(通過columns的平均receptive field計算)內(nèi),只有前n(如n=10,當(dāng)然也可以用總數(shù)的百分比)才能被激活。這樣,將所有滿足條件的columns激活,得到的就是輸入的稀疏離散表征。

在學(xué)習(xí)階段,需要更新權(quán)值,一般希望特定的突觸對于特定的輸入具有響應(yīng),這樣達到不同模式具有不同稀疏表征的效果,所以使得活躍column的潛在突觸中,所有連接活躍bits(=1)的突觸權(quán)值自增,而連接不活躍bits(=0)的突觸權(quán)值自減。其他column的突觸權(quán)值不變。

當(dāng)然,在sp中,有許多細節(jié)需要注意,比如說HTM希望所有的columns都要被用來進行一定模式的表征,所以那些因為覆蓋值(overlap,就是連接活躍bits的活躍突觸數(shù)目)長期不夠,與那些因為覆蓋值長期不能進入抑制半徑內(nèi)前列的columns突觸權(quán)值進行boosting,即增加其權(quán)值。

4、Temporal Pooler

當(dāng)輸入用稀疏離散表征后,得到活躍的columns,然后要進行temporal pooling。主要分為以下幾步:

首先,要對columns里面的細胞進行激活。細胞的激活分為兩種情況,第一種,區(qū)域之前沒有做出預(yù)測,那么,對于sp得到的激活columns中所有細胞進行激活;第二種,區(qū)域之前已經(jīng)做出了預(yù)測,那么,在每個活躍column中判斷是否有細胞在前一時刻被正確預(yù)測,如果有,僅僅激活該細胞,說明符合當(dāng)前上下文環(huán)境,如果沒有,那么將這一列的所有細胞進行激活,說明我還不清楚上下文環(huán)境是什么,所以所有上下文環(huán)境都有可能。而其他沒有被正確預(yù)測或者沒有再激活columns中的細胞保持或者變成不活躍。

其次,要進行預(yù)測。對于沒有被激活的細胞,觀察其連接的樹突,如果該樹突上連接活躍細胞的活躍突觸數(shù)目大于一定數(shù)目時,我們認為該樹突被激活,然后使得其連接的細胞被激活,當(dāng)一個細胞存在多個樹突被激活時,進行OR運算。

在學(xué)習(xí)階段,為了防止細胞過多的活躍突觸,從而過多進行預(yù)測,HTM一般希望每個活躍column中只有一個細胞進行學(xué)習(xí),在被正確預(yù)測了的細胞當(dāng)中,首先計算該細胞通過活躍突觸連接的之前處于學(xué)習(xí)狀態(tài)的細胞數(shù)目,當(dāng)其大于一定閾值時,進入學(xué)習(xí)狀態(tài);而對于沒有被正確預(yù)測的細胞,選取連接活躍突觸數(shù)目最多的細胞進入學(xué)習(xí)狀態(tài)。對進入學(xué)習(xí)狀態(tài)的細胞,將其活躍突觸權(quán)值自增,其他突觸權(quán)值自減。而對于一些之前被預(yù)測,當(dāng)前沒有被預(yù)測的(沒有激活的)細胞,說明之前預(yù)測有問題,所有該細胞連接的突觸自減。對于被正確預(yù)測的細胞,我們希望觀察它們是否做出了正確的預(yù)測,對于他們權(quán)值的強化更新,所以先存在隊列中,待到前進一定的time step再進行處理。可以看出,如果一個細胞被正確預(yù)測,HTM會強化這種前后細胞的轉(zhuǎn)移關(guān)系,強化記憶序列關(guān)系。

注:在文章中,對預(yù)測的性質(zhì)進行了很多解釋。一個重要的點就是預(yù)測使得層級的輸出變得更加穩(wěn)定,這是因為輸入模式可能連續(xù)變化,但是由于存在序列記憶,HTM會對輸出進行一步或者多步預(yù)測,變化的輸入可能只導(dǎo)致部分輸出發(fā)生變化,而其中正確預(yù)測而激活的細胞,以及那些相同的多步預(yù)測使得輸出變化比較小。當(dāng)然更高層的輸出更加穩(wěn)定,在上一個版本的HTM里也存在,因為變化的模式,可能是同屬于一個markov chain,一個group,所以在更高一層就有相似的輸出了。

5、與Version I的內(nèi)在聯(lián)系與主要區(qū)別

在這里,主要分析一下第二章與第三章所介紹的兩個HTM版本有什么內(nèi)在的聯(lián)系,又存在如何的區(qū)別。

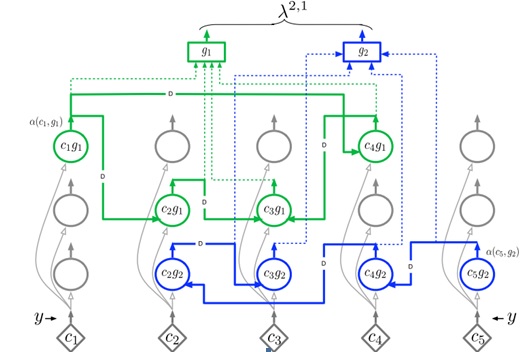

I,結(jié)構(gòu)。首先層級結(jié)構(gòu)相似自不必再說。我們看micro-structure。一乍看,前一個版本里面的存儲記憶的基本結(jié)構(gòu)是節(jié)點,這里是column。實際上兩者是很相似的,這里的columns相當(dāng)于之前的coincidences,而column中的細胞就是這個coincidences的不同狀態(tài),就比如之前的coincidences可以通過state-splitting劃分到不同的markov chain一樣。而細胞之間的突觸,實際上是group中的markov chain。如下圖4,是將一個節(jié)點的C,G轉(zhuǎn)換為各種細胞之間信息的傳遞的結(jié)構(gòu),這明顯地揭示了與新版本的相似之處。區(qū)別在于,group這個概念不再有,隱含在了稀疏離散表征里面,而且在新版本里面,突觸的連接可以說也是稀疏的,二值化后的突觸權(quán)值使得各細胞間不會所有信息都進行傳遞。

圖4 來自于George博士論文

II,功能。結(jié)構(gòu)的相似性決定了功能上也基本相似,序列記憶一個通過突觸權(quán)值實現(xiàn),一個通過markov chain來實現(xiàn)。稍微不同的是,新版本對輸入進行了稀疏離散表征,而在老版本中,如圖中,y會計算所有coincidences的certainty。這也是兩個版本的最大區(qū)別:稀疏離散表征。

6、總結(jié)

在這章,主要介紹了Numenta白皮書中介紹的HTM模型,對稀疏離散表征,空間沉積池(spatial pooler),時間沉積池(temporal pooler)進行了介紹,可以看出其對空間模式的提取是通過空間沉積池進行稀疏離散表征實現(xiàn)的,不同的column具有不一樣的表達部分模式的含義,不同的組合就是表征不同的模式;而時間模式是通過細胞橫向間的突觸權(quán)值實現(xiàn)的,通過加強前后模式之間的轉(zhuǎn)移權(quán)值,來實現(xiàn)對序列的記憶。該HTM模型除了引入稀疏離散表征,將markov chain,group等概念隱含到突觸權(quán)值上,但是,從實質(zhì)上與George中的模型沒有太多的區(qū)別,都為層級結(jié)構(gòu),都能夠進行記憶-預(yù)測。

層級實時記憶算法的實現(xiàn)

The implementation of HTM

該部分內(nèi)容還沒有進行完全,希望在之后的工作中逐漸豐富。

1、Encoder

基本思想是當(dāng)給定一個標(biāo)量用多少個bits表示,在最小值到最大值的區(qū)間范圍,以及總共輸出多少bits,就能夠根據(jù)在區(qū)間內(nèi)的任意輸入值,根據(jù)其標(biāo)量值所在位置,計算出輸出中那些bits為1。這樣,在數(shù)值上相近的標(biāo)量,在二進制表達上也比較相似。

對于二維圖像如何編碼,是一個比較困難的問題,因為他除了有灰度大小表示一定的含義外,同時也有像素間上下文的關(guān)系,所以在進行二進制化時是一個比較困難的事情。這部分需要繼續(xù)學(xué)習(xí)。

2、Spatial Pooler

3、Temporal Pooler

4、CLA Classifer

5、總結(jié)

總結(jié)與展望

通過學(xué)習(xí)Numenta的白皮書可以知道,現(xiàn)發(fā)布的HTM模型還只是利用單層去解決問題,當(dāng)然實現(xiàn)多層應(yīng)該比較簡單。同時該層主要是模擬了新皮質(zhì)的第3層功能,也沒有反饋,行為控制等等功能,以后的工作應(yīng)該是逐步完善HTM,使得其結(jié)構(gòu)功能盡可能的相似。

通過學(xué)習(xí),對于HTM的發(fā)展演變,模型的理論,結(jié)構(gòu),功能,如何進行學(xué)習(xí),識別,都有比較好的理解。但是還不足以發(fā)現(xiàn)文章的問題,我覺得自己的工作之后是要不斷通過進行實驗,來印證理論的同時,發(fā)現(xiàn)HTM的問題在哪里,所以下一步的工作重點將傾向于此。同時,我覺得HTM的優(yōu)勢是不是在于他不僅在層級之間有連接,同時,也增加了層級內(nèi)部的連接,所以是不是需要看一些其他的模型來對比一下呢?

一個問題:在George論文中的HTM能夠利用Belief Propagation理論來推導(dǎo)inference等的過程,那么能不能同樣用到Numenta現(xiàn)行的HTM模型中呢?

參考文獻

[1] D. George, "How the Brain Might Work: A Hierarchical and Temporal Model for Learning and Recognition",Ph.D Thesis, Stanford University, June 2008.

[2] D. George and J. Hawkins, "A Hierarchical

[3] D. George and J. Hawkins, "Belief Propagation and Wiring Length Optimization as Organizing Principles for Cortical Microcircuits", Technical report, Redwood

Neuroscience Institute.

[4] Jeff Hawkins, Dileep George and Jamie Niemasik, "Sequence memory for prediction, inference and behaviour", Philosophical Transactions on the Royal Society B, 2009.

[5] http://vicarious.com/

[6] http://www.kurzweilai.net/vicarious-announces-15-million-funding-for-ai-soft ware-based-on-the-brain

[7] http://numenta.com/grok/

[8] D. Maltoni, Pattern Recognition by Hierarchical Temporal Memory , Technical Report, DEIS - University of Bologna technical report, April 2011.

[9] E.M. Rehn and D. Maltoni, Incremental Learning by Message Passing in Hierarchical Temporal Memory , Neural Computation, vol.26, no.8, pp.1763-1809, August 2014.

[10] J. Hawkins, S. Ahmad and D. Dubinsky, "Hierarchical Temporal Memory including HTM Cortical Learning Algorithms",

hierarchical-temporal-memory-cortical-learning-algorithm-0.2.1-en.pdf

[11] https://github.com/MichaelFerrier/HTMCLA

[12] https://sourceforge.net/p/openhtm/

[13] https://github.com/numenta/nupic/wiki